はじめに:Rendererはパイプラインの「演出家」

こんにちは!これまでの記事で、私たちはメディアパイプラインの旅を順調に進めてきました。

- DataSource: データの旅の始まり

- Demuxer: 映像と音声の仕分け

- Decoder: 圧縮されたデータを元の「生データ」に復元

今回は、この旅の最終目的地であり、私たちが実際に映像を見たり音を聞いたりできる瞬間に直結するコンポーネント、Renderer(レンダラ)に焦点を当てます。

Rendererは、例えるなら「演出家」や「最終的な実行者」です。

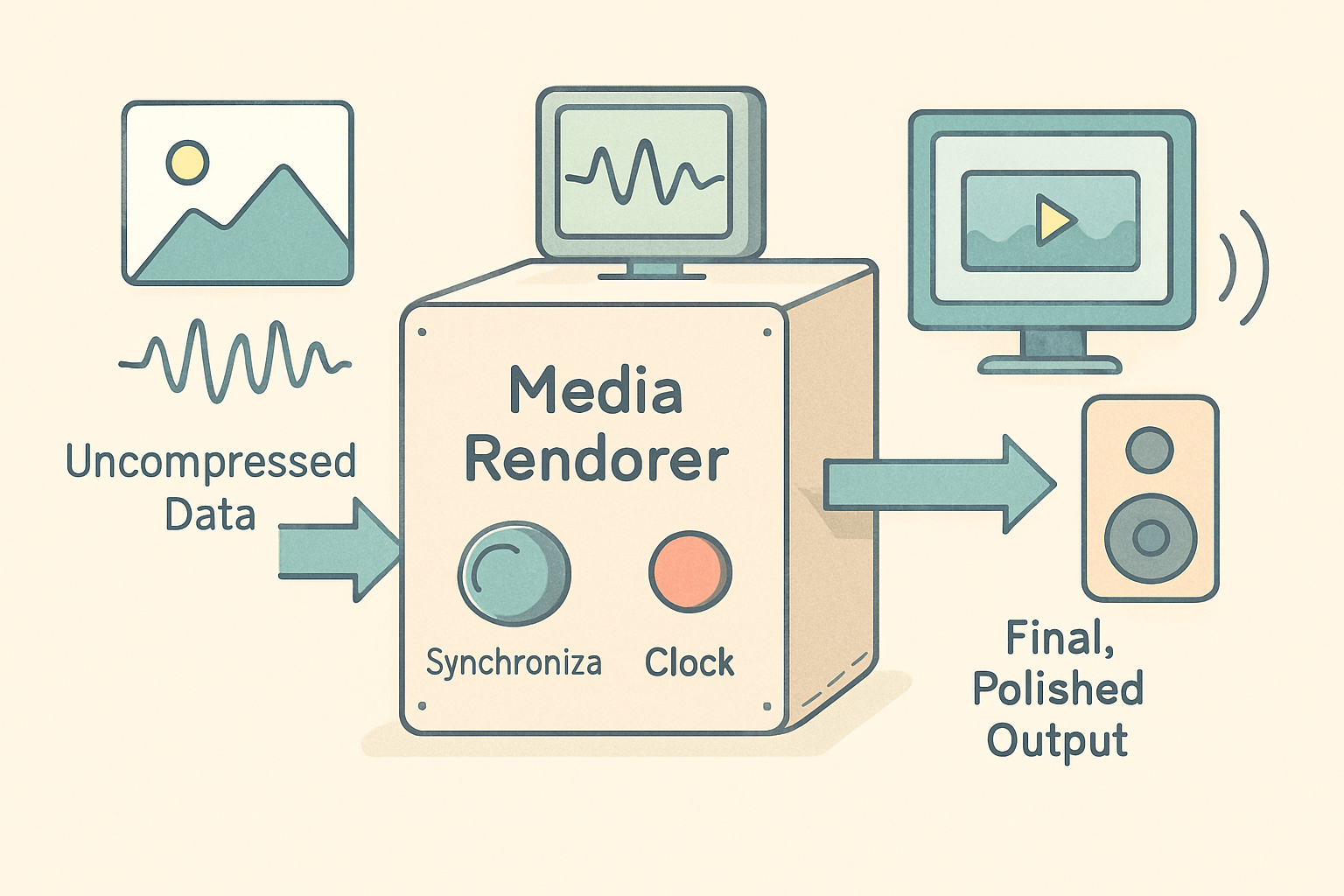

1.Rendererの役割:生データから現実へ

Rendererの仕事はシンプルかつ究極的です。それは、Decoderから送られてきた非圧縮の「生データ」を、画面やスピーカーという物理的な出力装置に届けることです。

映像と音声のRendererは、それぞれ異なる役割を担います。

1.1.映像Renderer(Video Renderer)

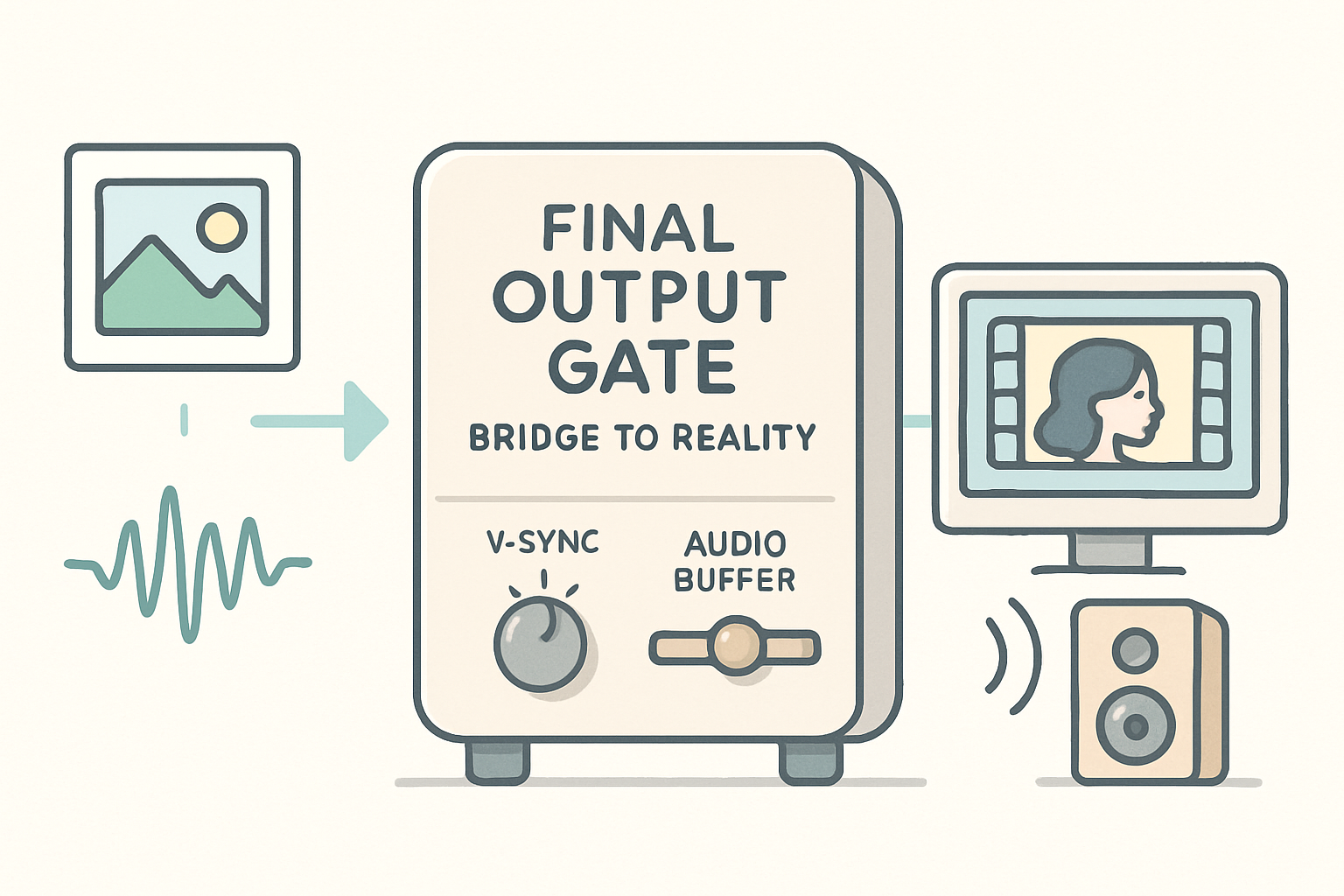

映像Rendererは、Decoderから送られてきたピクセルデータ(RGBやYUV形式)を受け取り、それを画面に描画します。

-

- 描画: データをグラフィックAPI(OpenGL, DirectX, Vulkanなど)に渡し、GPUを使って効率的に画面に表示します。

* 色空間変換: 必要に応じて、YUVからRGBへの変換など、最終的な表示に適した色空間への変換を行います。

- スケーリング: 動画のサイズと再生ウィンドウのサイズに合わせて、映像を拡大・縮小します。

1.2.音声Renderer(Audio Renderer)

音声Rendererは、Decoderから送られてきたPCMデータ(音の波形情報)を受け取り、それをスピーカーから出力します。

-

- ミキシング

- *: 複数の音源がある場合、それらを合成(ミキシング)します。

- 音量調整: ユーザーが設定した音量レベルに合わせて、データを調整します。

- 出力: データをOSのオーディオAPI(CoreAudio, WASAPI, ALSAなど)に渡し、最終的にスピーカーを駆動します。

2.最も重要な仕事:同期(Synchronization)

Rendererの仕事の中で、最も難しく、最も重要なのが同期(Synchronization)です。

映像と音声は、別々のストリームとしてパイプラインを流れてきますが、最終的に私たちが体験する動画では、完全に同期している必要があります。少しでもズレると、「音ズレ」という致命的な問題が発生します。

Rendererは、Demuxerが付与したPTS (Presentation Time Stamp)を頼りに、この同期を実現します。

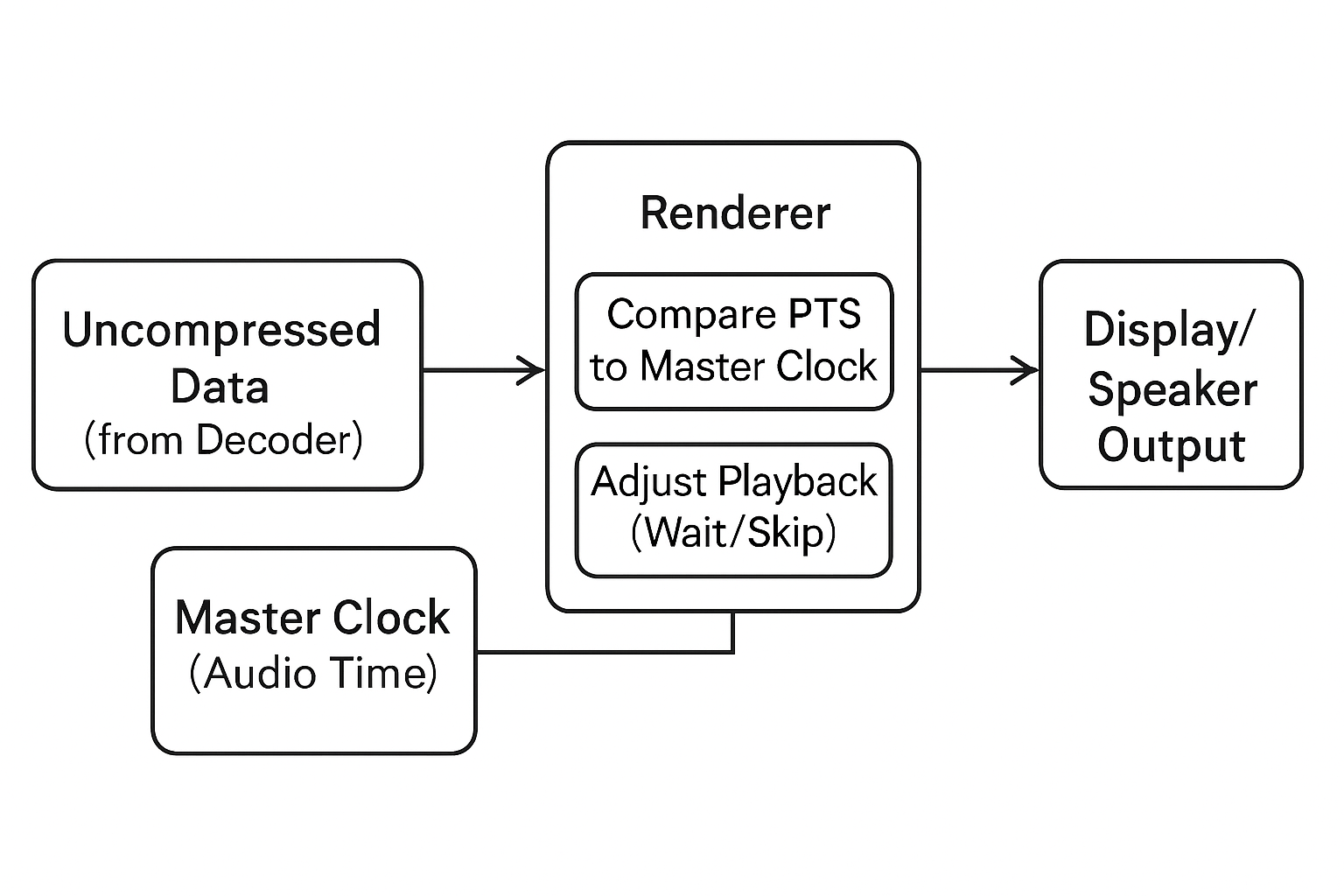

2.1.マスタークロックの存在

パイプライン全体には、マスタークロックと呼ばれる「時間の基準」が存在します。多くの場合、音声の再生時間がこのマスタークロックとして使われます。なぜなら、人間の耳は映像のズレよりも、音のズレに対して非常に敏感だからです。

2.2.PTSとマスタークロックの比較

-

- 音声Renderer: 音声データを再生し、その再生時刻をマスタークロックとしてパイプラインに提供します。

- 映像Renderer: 映像フレームを受け取ると、そのフレームのPTSと、現在のマスタークロックを比較します。

- 調整:

* PTS < マスタークロック: 再生が遅れているため、そのフレームをスキップして、次のフレームに進みます。

- PTS > マスタークロック: 再生が早すぎているため、そのフレームを待機させ、マスタークロックがPTSに追いつくのを待ちます。

- PTS ≒ マスタークロック: 適切なタイミングであるため、すぐに描画します。

この緻密な比較と調整を、毎秒何十回も繰り返すことで、映像と音声は完璧に同期して再生されるのです。

3.パイプラインの完成

Rendererがデータを処理し、画面とスピーカーに出力することで、メディアパイプラインの旅は完了します。

DataSource → Demuxer → Decoder → Renderer

この一連の流れが、私たちが普段何気なく見ている動画再生の裏側で、瞬時に、そして絶え間なく行われているのです。

まとめ:Rendererは感動を届ける最終ランナー

Rendererは、パイプラインの最終ランナーとして、複雑な処理を経て届けられたデータを、私たちが知覚できる「映像と音」という感動的な体験に変えてくれます。

このシリーズでは、MediaPlayerの主要なコンポーネントを一つずつ見てきました。この知識が、皆さんが次に動画を見たときに、その裏側で動いている技術に思いを馳せるきっかけになれば幸いです。

最後までお読みいただき、ありがとうございました!

コメント